CRM ანგარიშგება: გაყიდვებიდან მომსახურებამდე — KPI-ები, მართვის ძირითადი პრაქტიკები, ანგარიშები და ანალიტიკა ბიზნესისთვის

სამყარო ხელოვნური ინტელექტის ეპოქაშია, რომელიც თანდათან ჩვენი ცხოვრების ყველა სფეროში შემოდის და ჩვეულ სამუშაო გარემოს ფუნდამენტალურად ცვლის. დეველოპერები და ტექნოლოგიური გიგანტები მუდმივად მუშაობენ ახალ პროდუქტებზე. “AI based” ეტიკეტი თქვენი ბიზნესის გადაწყვეტილებებისადმი ინტერესის და მნიშვნელოვანი ინვესტიციის შემოდინების ერთგვარი გარანტია ხდება.

მაგრამ დიდ ძალასთან ერთად მოდის დიდი პასუხისმგებლობა. ერთის მხრივ, ხელოვნური ინტელექტი არის დამხმარე საშუალება კომპეტენტური ადამიანისთვის, რომელსაც შეუძლია გააუმჯობესოს ცხოვრების ხარისხი, გაზარდოს პროდუქტიულობა, ხელი შეუწყოს ინოვაციას და კონკურენტუნარიანობის ზრდას, თუმცა მას ასევე შეუძლია საფრთხე შეუქმნას ადამიანის უფლებებს, დემოკრატიას, უსაფრთხოებას და ბაზრებს. შესაბამისად, საჭიროა დავიცვათ ბალანსი ხელოვნური ინტელექტის განვითარების ხელშეწყობასა და მისი პასუხისმგებლობით გამოყენების უზრუნველყოფას შორის.

„ხელოვნური ინტელექტის“ ტერმინის გამოყენება პროდუქტის ან სერვისის დასახელებაში უკვე ფართოდ არის გავრცელებული. დღეს ეს გარკვეულწილად სავალდებულო პირობადაც კი მიიჩნევა წარმატების მიღწევისა და თანამედროვეობის აღიარებისთვის. გასული წლის განმავლობაში საზოგადოების დიდი ნაწილი თავისუფლად იყენებს ხელოვნური ინტელექტის ტექნოლოგიებს, როგორიცაა მაგალითად, ChatGPT, მისი გამოყენება სულ უფრო ნაკლებ ტექნიკურ მომზადებას მოითხოვს.

ბევრი ტექნიკური გიგანტი, მათ შორის Microsoft, ავითარებს ინტუიციურ ინსტრუმენტებს ძლიერ AI მოდელებთან ურთიერთობისთვის. მაგალითა Azure AI Studio არის პლატფორმა პოპულარული AI მოდელების განსათავსებლად, ხოლო Azure ML Studio არის პლატფორმა მანქანური სწავლებისთვის. ასეთი გადაწყვეტილებების წყალობით, კომპანიებს შეუძლიათ გადაიტანონ აქცენტი ადმინისტრირებისა და გადატანიდან პლატფორმასთან და მის პარამეტრებთან უშუალო ურთიერთქმედებისკენ. ეს არა მხოლოდ ამცირებს გადაწყვეტილებების დანერგვის დროს, არამედ ზრდის უსაფრთხოებისა და ინფორმაციის დაცვის დონეს.

ჩვენ სიღრმისეულად შევისწავლეთ ეს საკითხი და გსურს გაგიზიაროთ, რა რისკებს უქმნის ხელოვნური ინტელექტის ტექნოლოგიების რეგულაციების გარეშე გამოყენება ბიზნესს და ადამიანებს, ასევე გიზიარებთ პირველ ევროპულ კანონს, რომელიც აკონტროლებს ხელოვნური ინტელექტის ტექნოლოგიების გამოყენებას.

ხელოვნური ინტელექტის გამოყენება, მაგალითად, Microsoft-ის ეკოსისტემაში, საშუალებას აძლევს კომპანიებს სრულად გააკონტროლონ მუშაობა კორპორატიულ და კონფიდენციალურ მონაცემებთან და ასევე იძლევა შედეგების რეგულირების შესაძლებლობას. ეს სარგებელი

გადამწყვეტია ბიზნესისთვის, რადგან ისინი მინიმუმამდე ამცირებენ მონაცემთა გაჟონვასა და არაავტორიზებულ წვდომასთან დაკავშირებულ რისკებს.

რასაც ახლა ვხედავთ, მხოლოდ AI განვითარების ფართომასშტაბიანი ისტორიის დასაწყისია. მომხმარებლებთან საუბრისას ჩვენ ვხედავთ, რომ ყველა, გამონაკლისის გარეშე, განიხილავს AI-ის გამოყენების დიდ პერსპექტივებს თავიანთ ბიზნეს პროცესებში. ზოგიერთი კომპანია უკვე აქტიურად იყენებს ამ ტექნოლოგიებს, ზოგი კი კვლავ ეძებს ოპტიმალურ გადაწყვეტილებებს.

რისკები და მათი პოტენციური შედეგები, როგორც ჩანს, ძლიერი არგუმენტია მთავრობებისთვის, რათა წამოიწყონ გენერაციული AI ტექნოლოგიების რეგულირების პროცესი სახელმწიფო დონეზე. ყოველივე ამის შემდეგ, მხოლოდ რეგულირებას და ფიქსირებულ ეთიკურ სტანდარტებს შეუძლია უზრუნველყოს ბალანსი ტექნოლოგიურ პროგრესსა და ადამიანისა და ბიზნესის უფლებების დაცვას შორის.

ჯერ კიდევ 2023 წლის დეკემბერში, ევროკავშირის ქვეყნების პოლიტიკოსებმა და მინისტრებმა მიაღწიეს შეთანხმებას კანონის მთავარ საკამათო პუნქტებზე. ძირითადი მიზნები, რამაც გამოიწვია ევროკავშირში ხელოვნური ინტელექტის შესახებ კანონის აუცილებლობა, შეიძლება სამ ძირითად პუნქტამდე შემცირდეს:

თუმცა, აქტის შემდგომი მიღებისთვის ყველა საჭირო ზომა ვერ იქნა მიღებული, რადგან ზოგიერთი ევროპელი ავტორიტეტული წარმომადგენელი ბოლო დღეებამდე წინააღმდეგობას უწევდა შეთანხმების გარკვეულ ნაწილებს.

მთავარი მოწინააღმდეგე იყო საფრანგეთი, რომელმაც გერმანიასთან და იტალიასთან ერთად მოითხოვა მსუბუქი მარეგულირებელი რეჟიმი ძლიერი AI მოდელებისთვის, როგორიცაა OpenAI-ს GPT-4, რომლებიც მხარს უჭერენ ზოგადი დანიშნულების AI სისტემებს, როგორიცაა ChatGPT და Bard. სამი უმსხვილესი ევროპული ეკონომიკის ეს პოზიცია განპირობებული იყო პერსპექტიული ევროპული სტარტაპების შეზღუდვების შიშით, როგორიცაა Mistral AI და Aleph Alpha, რომლებსაც შეუძლიათ ამ ინდუსტრიის ამერიკული კომპანიების გამოწვევა. თუმცა, ევროპარლამენტმა ერთხმად მოითხოვა მკაცრი წესები ყველა მოდელისთვის გამონაკლისის გარეშე.

მიუხედავად ამისა, 21 მაისს ევროკავშირის საბჭომ საბოლოოდ დაამტკიც ა ხელოვნური ინტელექტის აქტი (AI აქტი), რომელსაც კენჭი უყარა ევროპარლამენტმა 13 მარტს. რეგულაციის მთავარი მიზანია ფუნდამენტური უფლებების, დემოკრატიის, კანონის უზენაესობისა და გარემოსდაცვითი მდგრადობის დაცვა იმ რისკებისგან, რომლებიც შეიძლება გამოიწვიოს ხელოვნურმა ინტელექტუალმა

ხელოვნური ინტელექტის აქტის (AI აქტი) ევროპულ მაგალითს უკვე უწოდებენ ეტალონს ტექნოლოგიური რეგულირების სფეროში და ვარაუდობენ, რომ გახდება მოდელი და სამუშაო შაბლონი კანონმდებლებისთვის მთელს მსოფლიოში. ეს კანონი ეხება ეკონომიკის ყველა სექტორს, გარდა სამხედროებისა და მოიცავს ყველა სახის ხელოვნურ ინტელექტ

ახალ წესებს სერიოზული შედეგები მოჰყვება ნებისმიერი ფიზიკური თუ იურიდიული პირისთვის, რომელიც ავითარებს, იყენებს ან ყიდის ხელოვნურ ინტელექტის სისტემებს ევროკავშირში. ამრიგად, კანონის მიღებას ორი ძირითადი მიზანი აქვს:

1) ხელი შეუწყოს ხელოვნური ინტელექტის განვითარებას, ინვესტიციებს და ინოვაციებს ამ სფეროში მკაფიო სამართლებრივი რეგულირებით;

2) AI ტექნოლოგიების გამოყენებასთან დაკავშირებული რისკების აღმოფხვრა ან მინიმუმამდე შემცირება.

ევროპარლამენტი აღნიშნავს, რომ AI აქტის წესები კრძალავს სახეების გამოყენებას ინტერნეტიდან და ვიდეოთვალთვალის საშუალებით სახის ამოცნობის მონაცემთა ბაზების

შესაქმნელად. ასევე აკრძალული იქნება ადამიანების ქცევით, მოწყვლადობით მანიპულირება და ემოციების ამოცნობა ხელოვნური ინტელექტის მოდელების გამოყენებით

მნიშვნელოვანია, რომ ხელოვნური ინტელექტის აქტი ასევე აწესებს მკაცრ შეზღუდვებს ზოგადი დანიშნულების AI გენერაციულ სისტემებზე (General purpose AI, GPAI). კერძოდ, ეს არის მოთხოვნები ევროკავშირის საავტორო უფლებების შესახებ კანონთან შესაბამისობისთვის, მოდელების ტრენინგის შესახებ ინფორმაციის გამჟღავნებასთან დაკავშირებით, რეგულარული ტესტირება და კიბერუსაფრთხოებასთან ადეკვატური შესაბამისობა.

რა თქმა უნდა, შეზღუდვები არ ამოქმედდება დაუყოვნებლივ, კანონის ძალაში შესვლიდან მხოლოდ 12 თვის შემდეგ. და მაშინაც, კომერციულად ხელმისაწვდომ გენერაციულ მოდელებს, როგორიცაა OpenAI’s ChatGPT, Google’s Gemini და Microsoft’s Copilot, მიეცემათ 36 თვიანი “გარდამავალი პერიოდი”, რათა მათი ტექნოლოგია შესაბამისობაში მოიყვანონ.

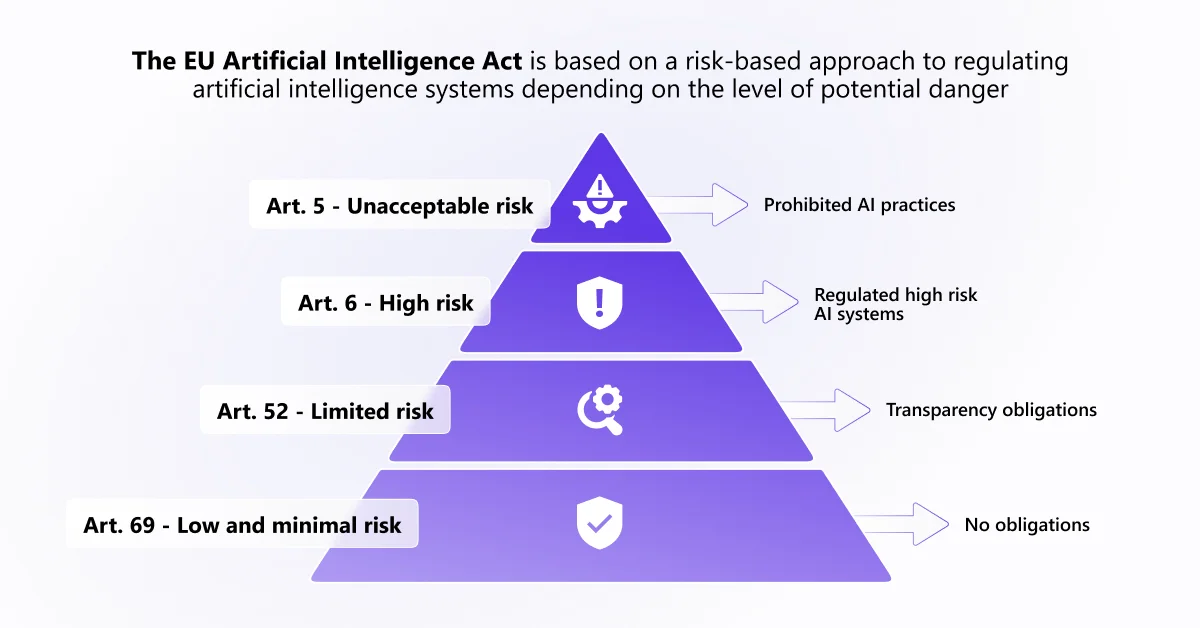

ხელოვნური ინტელექტის აქტი ეფუძნება რისკზე დაფუძნებულ მიდგომას, რომელიც განასხვავებს ხელოვნური ინტელექტის სისტემების ძირითად კატეგორიებს ზიანის მიყენების ალბათობისა და მისი სიმძიმის პოტენციური დონის მიხედვით

ევროკავშირის კომისიას ახლა აქვს სრული უფლებამოსილება დააჯარიმოს კომპანიები კანონის დარღვევისთვის 35 მილიონ ევრომდე ან კომპანიის წლიური გლობალური შემოსავლის 7%-ით. მცირე და საშუალო საწარმოებისთვის გათვალისწინებულია ჯარიმების უფრო დაბალი მასშტაბი მათი ინტერესებისა და ეკონომიკური სიცოცხლისუნარიანობის გათვალისწინებით.

კანონის შესრულებას მონიტორინგს გაუწევს ახლად შექმნილი ხელოვნური ინტელექტის ოფისი ევროკავშირის დონეზე. ამ ორგანოს ექნება მანდატი, შეაფასოს ზოგადი დანიშნულების მოდელები (GPAI) და დაეხმაროს ეროვნულ ხელისუფლებას მაღალი რისკის გენერაციული AI სისტემების ბაზრის ზედამხედველობაში. ასევე შეიქმნა ხელოვნური ინტელექტის ევროპული საბჭო, რომელიც შედგება ევროკავშირის წევრი ქვეყნების წარმომადგენლებისგან და პასუხისმგებელია კონსულტაციების, დასკვნებისა და რეკომენდაციების მიწოდებაზე.

თუ თქვენ ხართ მიმწოდებელი, დეველოპერი, იმპორტიორი, დისტრიბუტორი ან პირი, რომელიც ხელმძღვანელობს ხელოვნური ინტელექტის სისტემებით, თქვენ უნდა დარწმუნდეთ, რომ თქვენი AI პრაქტიკა შეესაბამება კანონის ახალ მოთხოვნებს. ამიტომ ჩვენ გთავაზობთ რამდენიმე პრაქტიკულ ნაბიჯს, რომელთა გადადგმაც დაუყოვნებლივ შეგიძლიათ:

შეაფასეთ თქვენი რისკები. დარწმუნდით, რომ თქვენს ორგანიზაციას აქვს AI რისკის მართვის კომპლექსური სისტემა და დანერგეთ შესაბამისი მოთხოვნები მონაცემთა ხარისხის, ტექნიკური დოკუმენტაციის, ადამიანური ზედამხედველობის, დაინტერესებული მხარეების ჩართულობისთვის და სხვა.

AI სისტემების გამჭვირვალობა და აღქმადობა. აცნობეთ მომხმარებლებს და სხვა დაინტერესებულ მხარეებს ხელოვნური ინტელექტის გამოყენების, მისი შესაძლებლობებისა და შეზღუდვების შესახებ და მიეცით მათ შესაძლებლობა გააპროტესტონ და გამოასწორონ AI-ზე დაფუძნებული გადაწყვეტილებები.

ცნობიერების ამაღლება. გაავრცელეთ სიტყვა და გაანათლეთ თქვენი თანამშრომლები ხელოვნური ინტელექტის უპირატესობებისა და რისკების შესახებ.

ეთიკური სტანდარტების შექმნა. ხელი შეუწყეთ ხელოვნური ინტელექტის მდგრად და ეთიკურ გამოყენებას თქვენი ორგანიზაციის სტრატეგიაში მისი ინტეგრირებით.

თვალყური ადევნეთ ახალ მარეგულირებელ ცვლილებებს, რათა წინასწარ განსაზღვროთ მათი გავლენა თქვენს ბიზნესზე და უზრუნველყოთ დროული შესაბამისობა

AI-ის აქტი არის ახალი ევროპული ციფრული სტრატეგიის ნაწილი, რომელიც, გარდა ხელოვნური ინტელექტისა, გავლენას ახდენს ციფრული სამყაროს სხვა ასპექტებზე. GDPR, CCPA და სხვა მარეგულირებელი აქტების მსგავსად, აქტი გავრცელდება ყველა კომპანიაზე, რომელიც გეგმავს ევროპულ ბაზარზე გასვლას. ის მიზნად ისახავს შექმნას ხელოვნური ინტელექტის ეკოსისტემა, რომელიც შეესაბამება ევროპულ ღირებულებებსა და რეგულაციებს და ხელს უწყობს ინოვაციებსა და კონკურენტუნარიანობას.

როგორც Microsoft-ის კორპორაციის პარტნიორები, ჩვენ ვაკვირდებით ღონისძიებების განვითარებას და ხელს ვუწყობთ გენერაციული AI-ის ეთიკურ გავრცელებას და გამოყენებას, რომელიც ამჟამად ხორციელდება როგორც Microsoft-ის, ასევე SMART business-ის გადაწყვეტილებების, აპლიკაციებისა და სერვისების განუყოფელი ნაწილი.

როგორია Microsoft-ის პოზიცია ევროპაში AI ტექნოლოგიის მართვისა და რეგულირების მოდელის შექმნის შესახებ? Microsoft აქტიურად არის ჩართული ხელოვნური ინტელექტის მარეგულირებელ დებატებში, უზრუნველყოფს ინფორმაციას მომხმარებლის გამოცდილებაზე და საკუთარ პასუხისმგებელ AI პროგრამაზე.

Microsoft-მა გააფართოვა თავისი ხუთპუნქტიანი გეგმა, რომელიც მან პირველად 2019 წელს გამოაქვეყნა, რათა აჩვენოს, თუ როგორ შეესაბამება დისკუსიებს ევროკავშირის AI კანონის შესახებ. გეგმა მოიცავს ისეთ პრინციპებს, როგორიცაა პასუხისმგებლობა, გამჭვირვალობა, სამართლიანობა, საიმედოობა და უსაფრთხოება.

თავის ოფიციალურ ბლოგშ Microsoft აცხადებს, რომ მხარს უჭერს ისეთ მარეგულირებელ რეჟიმს ევროპაში, რომელიც ეფექტურად გადაჭრის უსაფრთხოების საკითხებს და დაიცავს ფუნდამენტურ უფლებებს, ამავდროულად განაგრძობს ინოვაციის ხელშეწყობას, რომელიც უზრუნველყოფს ევროპის კონკურენტუნარიანობას გლობალურ დონეზე.

კორპორაცია ვალდებულია განახორციელოს ხელოვნური ინტელექტის რისკის მართვის ჩარჩო (NIST) და უსაფრთხოების სხვა საერთაშორისო სტანდარტები, რომლებიც მითითებული იქნება ხელოვნური ინტელექტის აქტში.

SMART business-ის პორტფოლიოს ყველა პროდუქტი აკმაყოფილებს როგორც ადგილობრივი, ისე საერთაშორისო სტანდარტებისა და მარეგულირებელი ნორმების მოთხოვნებს, რაც ამცირებს მომხმარებლის რისკებს და ეხმარება ბიზნეს პროცესების უსაფრთხოდ და

ლეგალურად მართვაში. ჩვენ ყოველთვის მზად ვართ გავხდეთ თქვენი საიმედო IT პარტნიორი და დაგეხმაროთ იმპლემენტაციასა და მხარდაჭერაში. ჩვენ გთავაზობთ: